一、理解AI安全边距的心要素

1.1 安全边距的数学本质

从技术角度看,AI安全边距通常体现为分类问题中的决策边界距离。以支持向量机(SVM)为例,安全边距就是不同类别数据点之间的分离间隔。在深度学习模型中,这个概念被扩展为模型对输入变化的度阈值——即输入可以有多大变化而不改变输出决策。

三、行业前沿:安全边距优化的创新方向

3.1 基于不确定性量化的边距控制

传统AI系统通常只提供点估计,而无表达自身的不确定性。新兴的贝叶斯深度学习技术能够量化模型预测的不确定性,为安全边距的调控提供了全新维度。这些方包括:

四、资深点评人观点

张教授(机器学习安全专家): "本文全面覆盖了AI安全边距从基础到前沿的关键技术,特别是对抗训练与不确定性量化部分的论述非常专业。不过我想补充一点:安全边距的设置本质上是一种风险分配决策,未来研究需要更紧密地结合考量,确保边距设置不仅技术上合理,也符合值观。"

1.2 影响安全边距的关键因素

安全边距的设置绝非一成不变,它受到多方面因素的动态影响:

2.2 对抗训练增边距鲁棒性

对抗性样本是AI安全边距面临的主要挑战之一——微小的输入扰动就可能导致模型产生完全错误的输出。通过将对抗样本纳入训练过程(对抗训练),我们可以显著提高模型在决策边界附近的鲁棒性,实质上相当于扩大了有效的安全边距。

2.3 基于化学习的动态边距调整

静态的安全边距设置往往难以适应复杂多变的环境。先进的做是采用化学习框架,让AI系统能够根据环境反馈动态调整其安全边距。这种方特别适用于自动驾驶等需要持续与环境交互的场景。

3.2 人机协同中的边距共享

在人类与AI协同工作的场景中,安全边距的设置需要考虑双方的能力特点。的研究提出了"动态边距共享"框架,根据人机各自的实时表现动态分配系统整体的安全余量。

李工程师(自动驾驶系统架构师): "动态边距调整部分完全说中了行业痛点!在实际工程中,我们确实发现静态参数无适应复杂环境。文章提到的化学习方与我们的技术路线高度一致,但读者应该注意,实时系统的计算开销限制仍然是巨大挑战。"

王分析师(AI研究员): "作者对人机协同边距共享的讨论非常有前瞻性。在AI日益深入人类决策领域的今天,如何设置技术系统的整体安全余量比单纯优化算参数更为关键。期待看到更多关于边距设置主化和透明化的讨论。"

陈产品经理(企业级AI解决方): "作为经常需要向客户解释安全设置的产品人员,我认为这篇文章在技术深度与可读性之间取得了很好的平衡。概率校准部分的例特别有说服力,我会直接引用这些例子向医疗客户说明为什么他们的AI系统需要特定配置。"

例如,Waymo的自动驾驶系统会根据实时路况(天气、能见度、交通密度等)动态调整跟车距离和制动提前量。在雨天气下自动采用更大的安全边距,而在理想条件下则可以适当收紧边距以提高交通效率。这种自适应能力使系统能够在保证安全的前提下化实用值。

例如,在AI辅助医疗诊断系统中,当医生处于疲劳状态时,系统会自动降低对医生判断的依赖权重,同时提高自身的安全边距要求;而当医生表现出时,则可以适当放宽AI的安全限制,充分利用人类专家的直觉优势。这种人机边距的动态平衡有望实现"1+1>2"的协同效应。

例如,在医疗影像分析中,经过良好校准的AI系统在给出90%的症概率时,实际应有接近90%的准确率。这种校准使医生能够根据可信任的概率值来设置适当的安全边距——比如只对概率超过85%的病例采取侵入性。

具体实现上,Projected Gradient Descent(PGD)对抗训练是目前最有效的方之一。它通过在训练过程中主动寻找每个样本附近最"危险"的扰动方向,并制模型在这些挑战性样本上也能正确分类,从而在决策边界周围创建更宽的"安全缓冲区"。

安全边距(Margin of Safety)本质上是指AI系统在决策时保留的额外"安全空间",它决定了系统在多大程度上能够容忍输入数据的噪声、模型的不确定性以及现实中的意外情况。一个恰当设置的安全边距,能够在系统鲁棒性和实用性之间找到平衡点——过小的边距可能导致系统脆弱易错,而过大的边距则可能使系统过于保守,丧失实用值。

AI系统如自动驾驶的感知模块,会将安全边距量化为车辆与障碍物之间的最小距离阈值;而金融风控AI则将其转化为信用评分高于拒绝门槛的缓冲区间。这些量化的安全参数直接决定了系统在边缘情况下的行为模式。

- 数据质量:训练数据的噪声水平和覆盖范围直接影响模型对安全边距的需求。数据越"干净"、覆盖面越广,理论上所需的安全边距可以越小。

- 模型复杂度:过于复杂的模型可能在训练数据上表现完美,但对未知数据的泛化能力差,往往需要更大的安全边距来补偿这种不确定性。

- 应用场景风险:医疗、航空等高风险领域自然需要比电影推荐系统大得多的安全边距。

- 实时性要求:实时系统由于计算时间有限,可能无进行充分的确定性评估,因此需要预设更大的安全缓冲。

二、AI安全边距调整的实用方论

2.1 基于概率校准的边距调整

AI系统特别是深度学习模型,常常存在"自信"问题——即使在不熟悉的情况下也会给出高置信度的预测。通过概率校准技术(如Platt Scaling或Temperature Scaling),我们可以让模型的输出概率更真实地反映其实际正确率,从而为安全边距设置提供可靠依据。

- 蒙特卡洛Dropout:通过在前向传播中随机丢弃神经元,产生多个预测结果,用预测分布的离散程度衡量不确定性。

- 深度集成:训练多个独立模型,用它们之间的分歧度作为不确定性指标。

- 证据深度学习:直接建模预测的分布参数,输出可信赖的置信度估计。

这些技术使AI系统能够区分"知道已知"(高确定性预测)和"知道未知"(识别出超出知识范围的情况),从而在真正需要的地方应用更大的安全边距。

AI安全边距调整:从基础概念到高级策略的全面指南

:AI安全边距为何如此重要?

在人工智能系统日益渗透到我们生活各个领域的今天,"安全边距"这一概念正逐渐从工程学术语转变为关乎系统可靠性的关键指标。想象一下,自动驾驶汽车在紧急情况下需要多少缓冲距离才能安全停车?医疗诊断AI在给出症阳性判断时需要多高的置信度才能误诊?这些问题的心都在于AI系统的安全边距设置。

相关问答

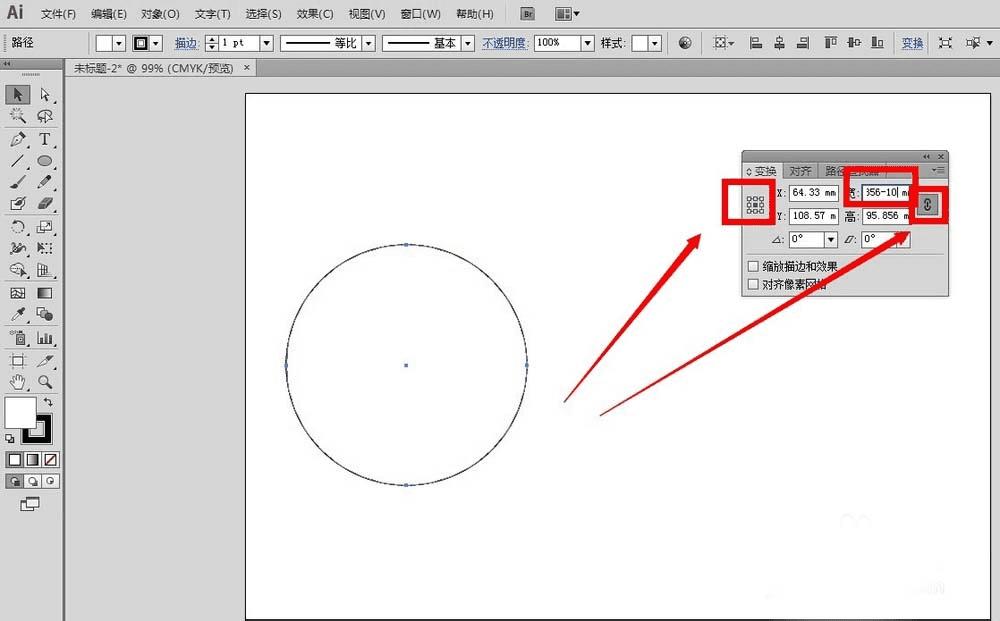

具体操作步骤如下: 需要准备的材料有:电脑、

AI1、首先打开电脑,点击打开

AI应用选项。2、然后在该页面中点击左侧“星形工具”选项将工具插入。3、之后在该页面中插入工具后点击左侧“选择工具”图标按钮。4、然后在该页面中将鼠标光标放在图片四周的点上鼠标左键单击拖动大小即可。选择工具箱中的“文字工具”,在画板中拖动出一个